17 juillet 2020

Lors de la RSA conference de 2019, Etienne Greeff, CTO d’Orange Cyberdefense et Wicus Ross, chercheur chez Orange Cyberdefense, ont présenté certaines des recherches qu’ils ont menées sur la manière dont l’intelligence artificielle pourrait être utilisée à des fins malveillantes.

Ils ont étudié comment, du point de vue de l’attaquant, l’IA s’avère être utile (encore plus utile que pour un défenseur, ont-ils supposé). Cette approche se tient car les attaquants continuent à évoluer pour essayer de devancer nos mesures défensives. Leurs victimes, bien humaines quant à elles, continuent d’être très routinières. Lorsque les cybercriminels savent ce qu’ils cherchent, ils se délestent alors d’une grande partie du travail manuel du processus d’attaque. Comme pour les fonctionnalités de Microsoft du passé proche et lointain (des pièces jointes aux macros), ils pourraient les mettre au service de l’attaquant. Seulement cette fois, à une toute autre échelle.

Au moment où les recherches d’Etienne et de Wicus ont été menées, cet ensemble de fonctionnalités n’était pas encore généralement disponibles. Nous avons été inspirés pour faire quelque chose qui pourrait être possible sous Windows, mais seulement avec ce qui existait à l’époque.

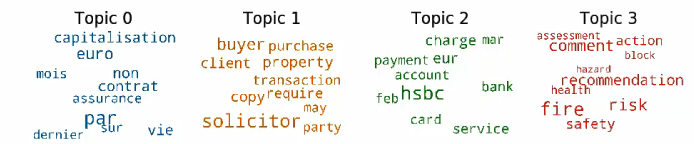

Avec l’aide d’Etienne et de sa connaissance de la modélisation des sujets, Wicus a entrepris d’écrire du code en Python (modules SKLearn, etc.) conçu pour fonctionner sous Windows, sans utiliser les bibliothèques Windows, mais toujours de manière transférable et fonctionnelle sur toutes les versions de Windows disponibles à ce moment-là.

Pour plus d’informations sur Windows ML, voir : https://docs.microsoft.com/en-us/windows/ai/windows-ml-container/getting-started

Wicus a réussi à invoquer et à utiliser les bibliothèques d’apprentissage machine dans les premières versions de Windows 10 sans déclencher aucune des alertes des logiciels malveillants. Il s’est très vite penché sur ce qu’il pouvait faire avec cette nouvelle capacité. Le principe était très simple :

Pour consulter la présentation d’Etienne Greeff et Wicus Ross à la RSA Conference, cliquez ici.

L’expérience a été couronnée de succès et a démontré la capacité de cibler rapidement et efficacement les informations intéressantes pour ensuite exfiltrer les données de manière sélective. Une approche moins suspecte que l’exfiltration totale des données en vue d’un examen plus approfondi dans un second temps.

Nous reviendrons aux analyses de Wicus. Mais d’abord, une petite disgression. Dans leur article “Practical Black-Box Attacks against Machine Learning“,[i] Papernot . ont étudié le principe selon lequel il ne suffit pas d’essayer d’attaquer les modèles d’apprentissage automatique ; il faut le faire sans connaître le modèle d’apprentissage automatique utilisé. Il s’agit donc d’un scénario de “boîte noire” plutôt que de “boîte blanche”.

Comment y parvenir ? Tout simplement, en exploitant les API. Les API sont essentielles dans le paysage technologique moderne de la cybersécurité. Combien de fois avez-vous été confronté à une entreprise qui vous a présenté son produit en utilisant la phrase “et bien sûr, nous avons une API ouverte”. Tout cela dans un esprit d’interopérabilité et de flexibilité.

Malheureusement, cette flexibilité pourrait également être exploitée. Autrefois, il était peut-être difficile pour les pirates de mettre la main sur la technologie de nos défenseurs. Aujourd’hui, combien de “dispositifs” de sécurité pouvez-vous acheter simplement sur les marchés Amazon ou Azure ? Comment empêcher un cybercriminel de faire tourner la toute nouvelle plateforme de défense basée sur l’IA et de lui envoyer des données ? Si vous voulez plus de détails à ce sujet, cliquez ici.

En résumé : si vous disposez de quelques données de test et de suffisamment de temps, vous connaissez les données d’entrée et, grâce à l’API, vous pouvez évaluer les résultats. Cela signifie que vous pouvez apprendre au fil du temps comment l’IA prend des décisions et finalement, l’amener à prendre la décision que vous souhaitez.

La capacité à imiter ou à recréer les modèles d’apprentissage des machines utilisés par les outils de cybersécurité est encore assez théorique. Pourquoi ? C’est très simple : les attaquants n’ont pas besoin d’être aussi sophistiqués. Il existe encore beaucoup de vieilles technologies.

Ce qui est le plus effrayant, c’est la façon dont la transformation numérique ouvre beaucoup plus de surfaces d’attaque. Et redonne vie à certaines anciennes. Prenons le typo-squatting de domaines. Vous vous souvenez de notre ami Wicus ? Et comment il jouait avec la modélisation de sujets ? Et bien, le premier exemple nécessitait toujours l’accès à la machine de l’utilisateur final et, par conséquent, il fallait savoir si l’organisation de défense avait les bons outils en place (détection et réponse aux points terminaux par exemple). Mais qu’en est-il de quelque chose qui n’a pas besoin d’accéder à la machine de l’utilisateur final ? Pouvons-nous obtenir beaucoup de données sans avoir à infiltrer un réseau ou à compromettre la machine de l’utilisateur ?

Nous avons pris six grandes sociétés immobilières, enregistré un grand nombre de domaines qui étaient de légères variations de leurs domaines légitimes (typosquatting pour ceux qui ne sont pas familiers) et mis en place un serveur de messagerie pour recevoir les courriers électroniques de nos nouveaux domaines. Tout ce que nous avions à faire était d’attendre.

De nombreux courriels arrivaient au fur et à mesure que les gens faisaient des erreurs de frappe dans les adresses électroniques et, à partir de là, nous nous tournions à nouveau vers la modélisation des sujets. Nous voulions à nouveau ne nous intéresser qu’aux courriels les plus importants. Et croyez-moi, nous avons recueilli beaucoup de messages.

Là encore, le processus s’est avéré très efficace. L’exploration de données à grande échelle n’est ainsi pas seulement utile aux organisations commerciales mais aussi aux cybercriminels.

De nombreuses entreprises effectuent une surveillance des domaines, mais beaucoup, beaucoup d’autres ne le font pas et n’y ont probablement même pas pensé. Mais lorsqu’il s’agit d’un moyen facile d’accéder à vos clients et à vos données, la mise en place d’une protection efficace n’est plus une option.

Pour résumer ce que nous avons exploré dans cette série d’articles, terminons par cette réflexion. La cyberguerre continue et les soldats sont toujours les mêmes des deux côtés. Ils n’ont pas (encore) été remplacés par des robots. Ils ont juste reçu des armes plus efficaces. Et vous allez avoir besoin de quelqu’un qui sait comment les utiliser, car l’ennemi le fait déjà.

[i] Papernot et al, Practical Black-Box Attacks against Machine Learning https://arxiv.org/pdf/1602.02697.pdf