22 juillet 2020

Dans la première partie de cette série sur la façon dont les humains devancent encore les machines, je me suis concentré sur les limites de l’IA et du Machine Learning en général. Cela pose les bases pour explorer plus en profondeur, dans le cadre de la cybersécurité, les domaines pour lesquels l’IA peut être utilisée.

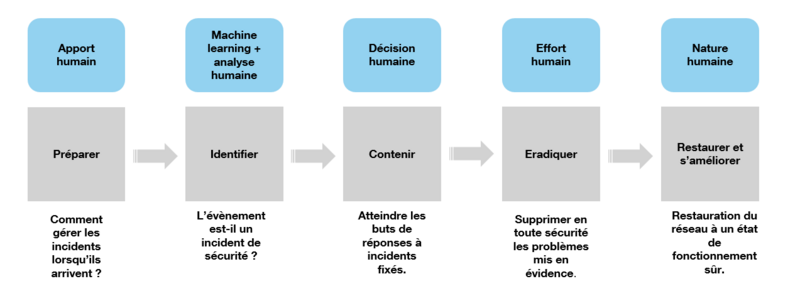

Examinons ainsi le cycle de vie typique de la réponse aux incidents :

Le Machine Learning et l’IA peuvent avoir une réelle valeur dans l’identification des menaces. On commence également à entrevoir leurs possibilités pour contenir les menaces. Mais, pour le moment, ce travail reste encore effectué par des humains. Si un logiciel voit quelque chose qui est très probablement une menace mais n’en est pas certain à 100% (car aucun logiciel de sécurité n’a cette capacité), comment pouvons-nous nous fier à ce même logiciel pour la contenir ?

Il ne fait aucun doute que ces solutions ont très probablement raccourci la phase d’identification et, de ce fait, ont été très utiles pour le processus de réponses à incidents. Mais il n’en reste pas moins que nous avons toujours besoin de l’homme pour :

– confirmer que la menace identifiée est réelle avec un degré de confiance élevé ;

– “appuyez sur le bouton”, par exemple pour isoler les machines infectées lors d’une attaque suspecte ;

– utiliser de multiples outils et techniques pour garantir l’éradication de la menace ;

– se remettre en selle, tirer des leçons et mieux se préparer pour la prochaine fois.

Pour simplifier, il y a une raison pour laquelle les services de détection et de réponse sont l’un des domaines d’activité d’Orange Cyberdefense qui connaît la plus forte croissance. Et c’est la combinaison d’un ensemble amélioré de technologies de détection, mais en conséquence, d’un volume considérable de données à analyser. Et en tant que tel, il n’y a jamais eu de plus grand besoin d’humains, dont nous manquons si désespérément, dans l’industrie de la cybersécurité.

Ensuite, il y a la question de savoir quelle IA choisir ? C’est le même vieux problème de la cybersécurité quand il s’agit de technologie : trop de fournisseurs possibles et autant de compromis potentiels sur la qualité. Rodney Brooks, dans son brillant essai The Seven Deadly Sins of Predicting the Future of AI, fait[i] référence à ce problème de performance par rapport à la compétence lorsqu’il s’agit de machines :

« Voilà le problème : les gens entendent dire qu’un robot ou un système d’IA a effectué une tâche quelconque. Ils généralisent alors, partant de cette performance spécifique pour en faire une compétence générale, que l’on pourrait attendre d’un humain, qui pourrait donc effectuer cette même tâche. Et ils appliquent cette généralisation à tout robot ou système d’IA ».

Ainsi, lorsque nous voyons par exemple qu’un fournisseur de technologie commercialise un très bon produit pour analyser le trafic réseau et qu’il fait ensuite appel à un autre logiciel pour unifier la solution, nous supposons simplement que parce qu’il a créé de solides modèles d’apprentissage machine pour analyser le trafic réseau suspect et malveillant, la même qualité sera transférée au second logiciel. Ce sont pourtant des situations différentes.

Elles font toutes partie du même puzzle lorsqu’il s’agit du comportement des attaquants tout au long du cycle de vie d’une attaque, mais néanmoins, l’apprentissage machine n’est pas si adaptable. Au contraire, certaines des meilleures IA que nous avons vues chez Orange Cyberdefense utilisent de nombreux modèles d’apprentissage machine au sein de leur produit pour identifier différents types de menaces et analyser différents types de comportements.

Ainsi, faire appel au Machine Learning ou l’IA n’est pas toujours le choix le plus pertinent. La détection basée sur les signatures ne suffit plus depuis longtemps et, de ce fait, le temps où l’IA et le Machine Learning étaient considérés comme de la magie noire, utilisés uniquement par les plus grands innovateurs, est certainement révolu. Le plus important reste de nous assurer que nous comprenons suffisamment l’IA et le Machine Learning pour prendre des décisions intelligentes et éclairées sur ces technologies, les comprendre et avoir les capacités requises pour les faire fonctionner correctement. Et pour de nombreuses entreprises, l’externalisation de cette fonction reste la seule option. La technologie seule (oui, même la technologie basée sur l’IA) ne peut pas encore tout faire.

Dans le prochain et dernier épisode, nous nous concentrerons sur ce qui se passe lorsque l’IA est entre de mauvaises mains…